「最近のAIはまるで人間のように感情があるみたいだ」「数学の難問を解けるなら、思考力があるのでは?」

AIの驚異的な進化を目の当たりにして、期待と不安が入り混じった感情を抱いている方は多いはずです。

しかし、Appleの研究チームが発表した論文(GSM-Symbolic)は、その幻想に一石を投じる衝撃的な内容でした。

結論から言うと、現在のAIは「考えて」いるのではなく、高度な「パターンマッチング」をしているに過ぎない可能性が高いことが示唆されたのです。

この記事を読めば、AIがなぜ賢く見えるのか、そしてなぜ時として信じられないようなミスをするのかという「仕組みの正体」がわかります。AIを正しく理解し、ビジネスや開発で「最強のツール」として使いこなすためのヒントを手に入れましょう。

Appleが証明した「GSM-Symbolic」とは?

従来のテスト(GSM8K)の裏側にあった盲点

これまでAIの知能を測るには「小学校の算数文章題(GSM8K)」が使われてきました。多くのモデルが満点に近いスコアを出していましたが、Appleはこう考えました。

「これ、ただ答えを暗記してるだけじゃないか?」

数字を少し変えるだけでAIがパニックに?

研究チームは、問題文の人名や数字をランダムに入れ替える「GSM-Symbolic」という手法でテストを行いました。

論理が同じであれば正解できるはずですが、実際には多くの最新モデルで正答率が低下しました。 つまり、AIは論理を理解しているのではなく、特定の数字の組み合わせパターンに依存していたのです。

なぜAIは「ヒッカケ問題」に弱いのか?

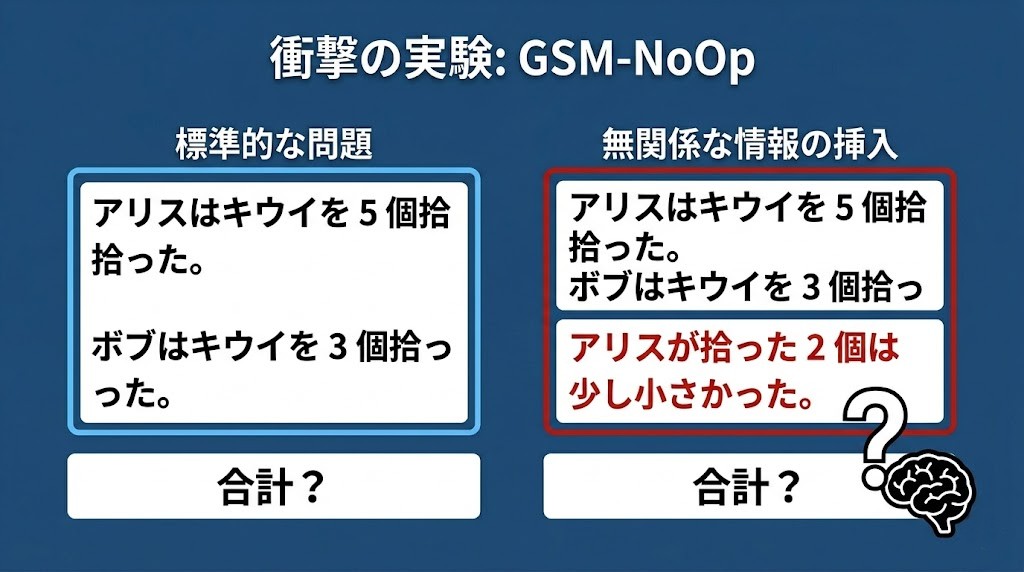

衝撃の実験「GSM-NoOp」

研究の中で最も興味深いのが、計算に全く関係のない「無関係な情報(ノイズ)」を1文加える実験です。

【実験例:キウイの問題】

「キウイを5個、翌日に3個拾った。合計は?」

ここに「昨日拾ったうちの2個は小さかった」という文を足します。

人間なら無視できますが、AIはこの「2個」を勝手に合計から引いてしまうなどのミスを連発しました。

AIには「情報の取捨選択」ができない

以下の表は、論文で示唆されたAIと人間の決定的な違いをまとめたものです。

| 特徴 | 人間の推論 | 現在のAI (LLM) |

| 処理の仕組み | 論理のステップを組み立てる | 確率的に次に来る言葉を予測 |

| ノイズへの耐性 | 不要な情報を無視できる | 全ての情報をパターンに組み込む |

| 一般化能力 | 未知の数字でも解ける | 過去の訓練データに近いほど強い |

AIに「感情」や「知性」はあるのか?

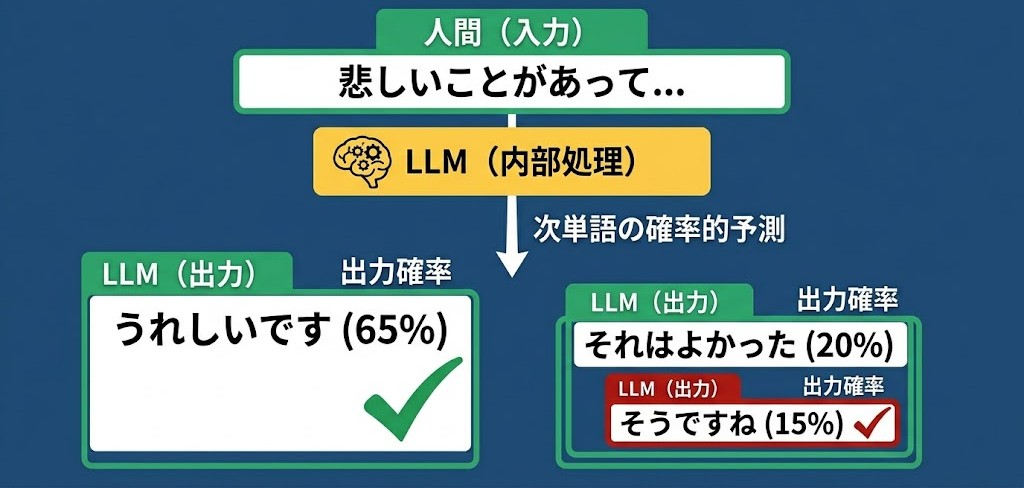

感情があるように見える「仕組み」

AIが共感してくれたり、熱く議論してくれたりすると、そこに「心」を感じるかもしれません。しかし、これはITエンジニアの視点で見れば「極めて高度な文脈模倣」です。

AIは「悲しい」という言葉の後に続くべき「励ましの言葉」を、膨大なデータから予測して出力しているに過ぎません。

知性をどう定義するか

Appleの論文は、AIが「形式的な論理推論(Formal Reasoning)」を行っていないことを示しました。

しかし、これはAIが無能だという意味ではありません。「世界中の知識を検索・要約し、人間が使いやすい形で出力するインターフェース」としては、依然として人類史上最強のツールです。

【実践編】AIを賢く活用する「いい例・悪い例」

知能の限界を知った上で、どう活用するのが正解でしょうか?

✅ いい例:パターンの力を最大化する

- プログラミングのひな型作成: 定型的なコード生成はAIの得意分野です。

- 膨大な資料の要約: 既存の情報をまとめる作業は、パターン抽出の真骨頂です。

- アイデアの壁打ち: 自分の発想にない「パターン」を提示させる。

❌ 悪い例:AIに全任せしてはいけないケース

- 複雑な多段階の論理計算: 1ステップ間違うと、最後まで間違いを引きずります。

- 情報の取捨選択が必要な分析: ノイズが含まれるデータを与えると、AIは混乱します。

- 最新情報の事実確認: 訓練データにないパターンは「もっともらしい嘘(ハルシネーション)」で埋められます。

💡 E-E-A-Tアドバイス

エンジニアとして開発にAIを取り入れる際は、必ず「検証ステップ(Unit Test)」をセットにしてください。AIは「論理」ではなく「確率」で動いているため、昨日正解した問いに今日間違える可能性があります。AIを「思考のパートナー」ではなく、「超高速な下書き作成ツール」と定義するのが、最も事故が少なく生産性が高い活用法です。

まとめ:AIの正体を知れば、もっと自由になれる

Appleの論文は、AIが万能の神ではないことを証明しました。

- AIは論理的に考えているのではなく、確率的なパターンマッチングを行っている。

- 無関係な情報に弱く、数学的な推論には限界がある。

- しかし、その特性を理解すれば、強力な作業支援ツールになる。

AIに感情や意思があるかどうかを議論するよりも、その「強力なパターンマッチング能力」を自分のスキルとどう掛け合わせるか。それが、これからの技術者に求められる真の知性と言えるでしょう。

コメント