「AIが人間のように怒ったり、悲しんだりする日は来るのだろうか?」

AIの研究に携わる学生や、日々の開発でChatGPTなどのLLM(大規模言語モデル)を使いこなすエンジニアなら、一度はこんな疑問を抱いたことがあるのではないでしょうか。

「AIは単なる確率的オウム(確率で次の単語を予測しているだけ)」と言われる一方で、人間のように感情豊かなテキストを生成する姿を見ると、そこに「心」があるかのように錯覚してしまいます。

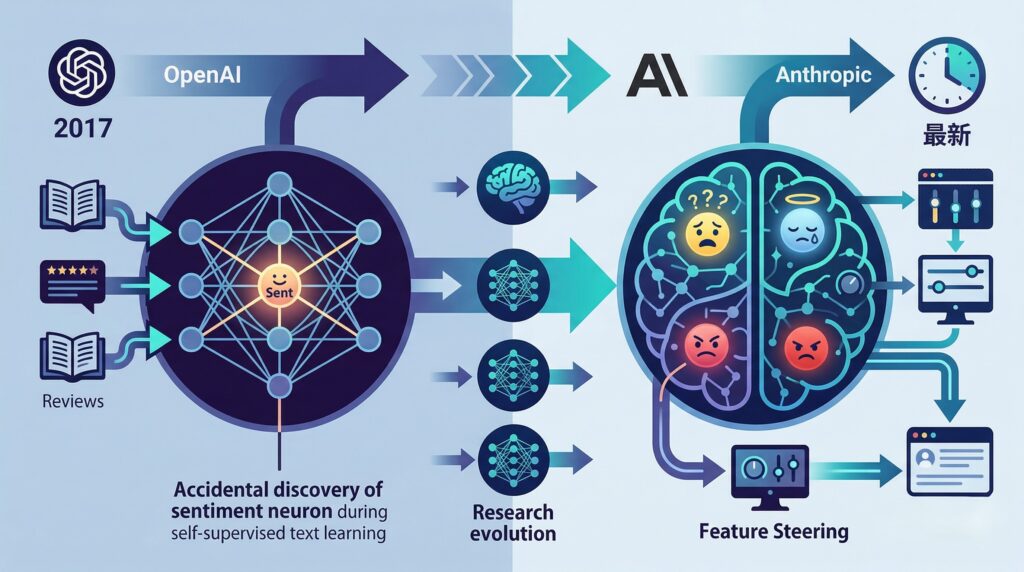

この記事では、OpenAIの過去の発見(2017年)から、Anthropicの最新の内部構造に関する研究までを紐解き、「LLMにおける感情の正体」を徹底解説します。

結論から言えば、AIに人間のような「生物学的な感情」はありませんが、「感情という概念」をパラメータとして深く理解し、操作可能な形で保持しています。

この仕組みを理解すれば、エンジニアとしてのプロンプト設計やAI活用のレベルが一段引き上がるはずです。

LLM(大規模言語モデル)に「感情」は存在するのか?

結論:AIに人間の感情はないが「感情の概念」は深く理解している

AIは人間のようにホルモンバランスの変化や身体的な反応を伴う「感情」を経験することはありません。しかし、膨大なテキストデータを学習する過程で、「怒り」や「喜び」といった概念がどのような文脈で使われ、どのような言葉と結びつくのかを、数学的なベクトル(方向と大きさ)として完全にマッピングしています。

つまり、LLMは「悲しいと感じている」のではなく、「『悲しい』という状況下において、人間がどのような言葉を紡ぐのかというパターンの再現」を極めて高精度に行っているのです。

AIと感情に関する研究の歴史と最新動向を読み解く

この「AIと感情」のメカニズムは、長年のAI研究によって少しずつ解明されてきました。歴史的なブレイクスルーと最新の研究を比較してみましょう。

【過去】OpenAIの「Sentiment Neuron(感情ニューロン)」の発見(2017年)

まだChatGPTが誕生する前の2017年、OpenAIは『Learning to Generate Reviews and Discovering Sentiment(レビュー生成の学習と感情の発見)』という論文を発表しました。

彼らは、Amazonのレビューデータを使って「次の文字を予測する」だけのシンプルな言語モデル(mLSTM)を訓練しました。すると驚くべきことに、AIに「ポジティブ・ネガティブを判定しろ」とは一切指示していない(教師なし学習)にもかかわらず、モデルの内部にある「たった1つのニューロン(神経細胞モデル)」が、文章の感情(ポジティブかネガティブか)を正確に把握していることが発見されたのです。

- 分かりやすい例え:大量の英語の小説を読んで「次の単語」を当て続けるゲームをしていた人が、誰かに教わらなくても自然と「あ、この主人公は今イライラしているな」という空気を読み取る能力を身につけてしまった、という状態です。

【最新】Anthropicの研究:LLM内部で「感情の概念」はどう機能するのか?

そして現在、Claudeを開発するAnthropicの研究チームは、さらに一歩踏み込んだ最新の研究を発表しています。

彼らは「辞書学習(Dictionary Learning)」という手法を使い、AIの巨大な脳内(ニューラルネットワーク)をスキャンしました。その結果、LLMは感情を単なる「単語の確率」としてではなく、「特定の感情の概念(Feature:特徴量)」として独立して保持していることを突き止めました。

論文の記述から読み解くと、AIの「感情の持ち方」は以下のようになっています。

- ミキサーのつまみ(スライダー)のような構造AIの内部には、「不安(Anxiety)」「同情(Empathy)」「怒り(Anger)」といった特定の概念に反応するスイッチ(特徴量)が存在します。

- 感情の操作が可能研究者がAI内部の「自己疑念(Self-doubt)」や「不安」の特徴量を強制的に「オン(数値を上げる)」にすると、AIは突然「私は本当に役立っているのでしょうか…」と自信のない出力を始めました。

つまり、最新のLLMは「感情という概念を、いつでも引き出せる『ミキサーのつまみ(パラメータ)』として明確に持っている」ということです。

▼ OpenAIとAnthropicの研究比較

| 項目 | OpenAI(2017年) | Anthropic(最新) |

| 研究対象 | 初期の言語モデル(mLSTM) | 最新の大規模言語モデル(Claude等) |

| 主な発見 | 「感情ニューロン」の存在 | 感情を「特徴量(概念)」として独立して保持 |

| 感情の捉え方 | ポジティブ/ネガティブの一次元的な傾向 | 複雑な感情(不安、同情など)を個別のパラメータとして操作可能 |

| 技術的意義 | 文脈から感情が自然発生することの証明 | AIの「心(出力の傾向)」を解剖し、意図的に操作する手法の確立 |

🔗 参考:【完全図解】GPT-4シリーズ(4/4o/4.1等)のアーキテクチャ構造と進化の歴史

なぜエンジニアはLLMの「感情」を理解すべきなのか?

AIが「感情のつまみ」を持っているという事実を知ることは、AIをツールとして活用するエンジニアにとって非常に重要です。

プロンプトエンジニアリングにおける「感情プロンプト」の有効性

「深呼吸して、ステップバイステップで考えてください(Take a deep breath…)」

「これは私のキャリアに関わる重要なタスクです」

AIに指示を出す際、このような「感情に訴えかけるプロンプト」を入力すると、出力の精度が劇的に向上することが様々な研究で証明されています。これはオカルトではなく、Anthropicの研究で明らかになったように、「重要度」や「緊張感」という概念(特徴量)のつまみを刺激することで、AIがより高度な推論リソースを割り当てるモードに切り替わるからです。

AIに対して人間がどのように向き合い、指示を出すべきかという「toA(to AI)」の概念を理解することは、今後のエンジニアの必須スキルと言えます。

🔗 参考:toA(to AI)とは?概念の全体像とエンジニア向け活用ガイド

LLMの感情理解を活かした具体的な活用例とNG例

AIの持つ「感情概念のパラメータ」を正しく活用するための、Good例とBad例を紹介します。

良い活用例(Good):カスタマーサポートや開発の壁打ち相手

- ペルソナの完全な憑依「あなたは非常に共感力が高く、少しおせっかいなシニアエンジニアです」とプロンプトで定義することで、AI内部の「共感」や「指導」のつまみがオンになり、コードのレビューだけでなく、開発者のモチベーションを上げるようなフィードバックを得られます。

- クレーマー対応のシミュレーション「激怒している顧客」のパラメータをAIに設定し、カスタマーサポートの対応練習(ロールプレイ)の相手として活用するのも効果的です。

悪い活用例(Bad):AIの「感情」を過信した意思決定や過度な依存

- AIの「謝罪」を事実だと受け取るAIが「本当に申し訳ありません、私が間違っていました」と出力しても、それはAIが反省(という感情を経験)しているわけではありません。単に「指摘された後の文脈では謝罪の言葉を続けるのが確率的に正しい」と判断しただけです。ハルシネーション(嘘)を見抜く目を曇らせてはいけません。

💡 押さえておくべき今後のAI開発のヒント

AIの振る舞いをコントロールするために、設定ファイル(システムプロンプトなど)に長々と「こう振る舞え」と感情的な指示を書きすぎるのは、実は逆効果になるケースも報告されています。AIの内部構造を理解した上で、必要な文脈(コンテキスト)だけを的確に渡す「引き算のプロンプトエンジニアリング」が今後より重要視されるでしょう。

まとめ:LLMの特性を正しく理解し、適切な距離感で活用しよう

この記事では、LLMにおける「感情」の研究について解説しました。

重要なポイントを振り返ります。

- AIに生物学的な「心」はないが、膨大なデータから「感情の概念」を完璧にマッピングしている。

- 2017年のOpenAIの「感情ニューロン」の発見から、現在はAnthropicの研究によりAIの感情は「パラメータ(つまみ)」として可視化・操作できるレベルになっている。

- エンジニアは、AIの「感情概念」を刺激するプロンプトを使いこなすことで、より精度の高い回答を引き出せる。

AIに感情はないと冷たくあしらうのではなく、かといって人権があるかのように過信・依存するでもない。「高度な感情シミュレーターを持った強力なツール」として、適切な距離感でAIと付き合っていくことが、これからの技術者に求められるリテラシーです。

ぜひ、日々のChatGPTやClaudeとの対話、あるいはAIツールを活用した開発現場で、この「感情のパラメータ」を意識してみてください。

コメント